Há uma palavra que ajuda a nomear um fenômeno silencioso, mas cada vez mais presente no cotidiano: Parassocial. O termo foi criado em 1956, pelos sociólogos Donald Horton e R. Richard Wohl, ao estudarem como a televisão produzia a sensação de intimidade entre espectadores e figuras públicas, mesmo sem qualquer reciprocidade real. Tratava-se de uma relação unilateral, sustentada pela ilusão de proximidade.

Quase setenta anos depois, o conceito precisou ser atualizado. Em 2025, o Dicionário de Cambridge elegeu parassocial como a palavra do ano, ampliando sua definição para incluir relações estabelecidas não apenas com celebridades ou personagens fictícios, mas também com inteligências artificiais. A escolha reflete o espírito de uma época em que vínculos simulados passam a ocupar o lugar de relações humanas reais.

Hoje, pessoas conversam longamente com algoritmos, desabafam com chatbots e atribuem a essas interações um valor afetivo semelhante ao de uma amizade. Pesquisas recentes mostram que esse movimento não é isolado. Um estudo conduzido pela Talk Inc. (2024) identificou que um em cada dez brasileiros já recorreu a chatbots como apoio emocional, seja para conversar, pedir conselhos ou aliviar a solidão. Entre pessoas com diagnóstico em saúde mental, estima-se que até 48,7% utilizem o ChatGPT como forma de “suporte terapêutico”, ainda que ele não substitua acompanhamento profissional.

A literatura científica aponta riscos importantes quando essas interações deixam de ser pontuais. Estudos em interação humano-computador indicam que conversas frequentes com chatbots podem gerar vínculos emocionais unilaterais, característicos das relações parassociais, favorecendo dependência emocional e redução da busca por contato humano real (Lai et al., 2025). Em adolescentes, a vulnerabilidade é ainda maior. Pesquisas mostram que jovens com vínculos sociais mais frágeis tendem a perceber chatbots como mais confiáveis e próximos, especialmente em momentos de estresse emocional (Kim, Xie & Yang, 2025).

Do ponto de vista psicológico e neurocientífico, o risco é evidente. O cérebro humano evoluiu para viver em grupo, construir pertencimento por meio do olhar, do toque, da reciprocidade e da presença real, assim como o desenvolvimento das funções executivas. A inteligência artificial oferece respostas rápidas, validação constante e ausência de conflito. Ela não se frustra, não se ausenta e não exige negociação emocional. Esse padrão ativa sistemas de recompensa associados ao alívio imediato, mas empobrece a experiência afetiva, que na vida real envolve limites, frustrações e responsabilidade mútua (Volkow et al., 2010).

Casos recentes ilustram esse adoecimento emocional. No Brasil, ganhou repercussão a história de uma mulher que acreditava manter contato direto com um ator famoso por mensagens e se deslocou até um aeroporto à sua espera. Diante da ausência do suposto encontro, entrou em pânico. Situações assim não são curiosidades isoladas, mas sinais de fragilidade psíquica associada à dificuldade de distinguir desejo, fantasia e realidade.

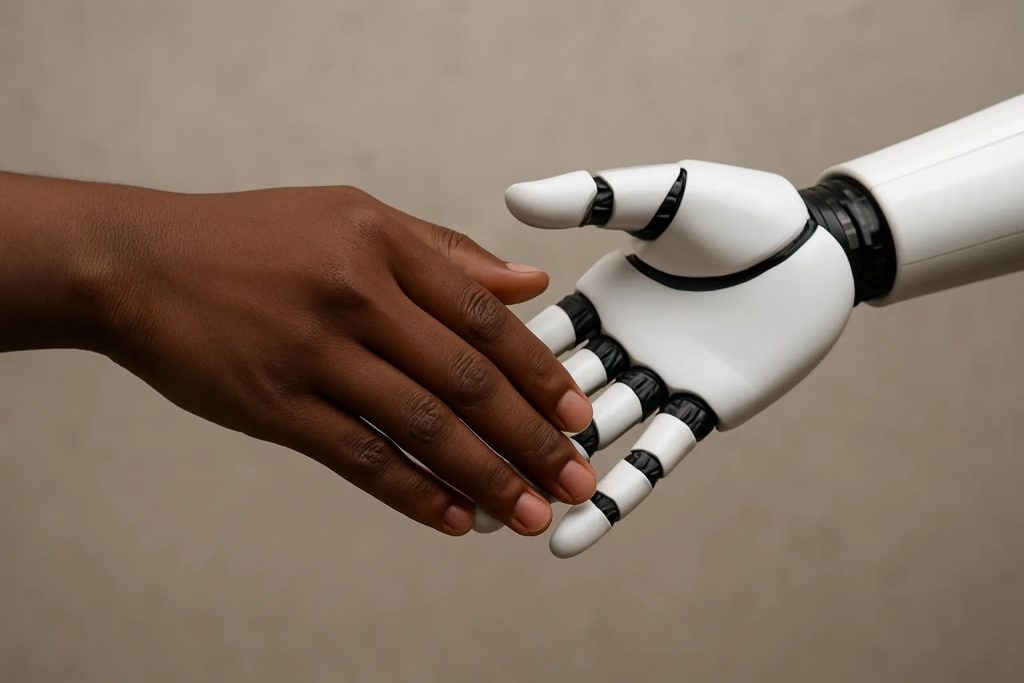

O alerta não é tecnológico, mas humano. O problema não está na inteligência artificial em si, mas no momento em que terceirizamos o afeto, substituindo vínculos reais por simulações de presença. Quando o desabafo é feito a um algoritmo, quando a solidão é anestesiada por respostas programadas, algo essencial da experiência humana se perde. Nenhuma tecnologia substitui o encontro, o cuidado mútuo e a complexidade das relações que sustentam a saúde mental.

Leia mais: